Anthropic: китайские хакеры использовали Claude Code для кибершпионажа - «Новости»

- 14:30, 15-ноя-2025

- Новости / Преимущества стилей / Добавления стилей / Вёрстка / Отступы и поля / Изображения / Заработок

- Влада

- 0

Китайские хакеры применяли ИИ-инструмент Claude Code для атак на 30 крупных компаний и правительственных организаций. По данным Anthropic, в некоторых случаях злоумышленники добились успеха.

Новый отчет Anthropic гласит, что вредоносная кампания разворачивалась в середине сентября 2025 года и затронула крупные технологические компании, финансовые институты, химических производителей и госучреждения.

Разработчики Claude подчеркивают: несмотря на то, что цели для атак выбирали люди, это первый задокументированный случай, когда агентный ИИ успешно использовался для получения доступа и сбора данных в системах «подтвержденных ценных целей», включая крупные технологические компании и государственные учреждения.

Исследователи отслеживают китайскую APT-группировку, стоявшую за этими атаками, под идентификатором GTG-1002. Сообщается, что хакеры использовали Claude Code и Model Context Protocol (MCP) для проведения атак без участия человека.

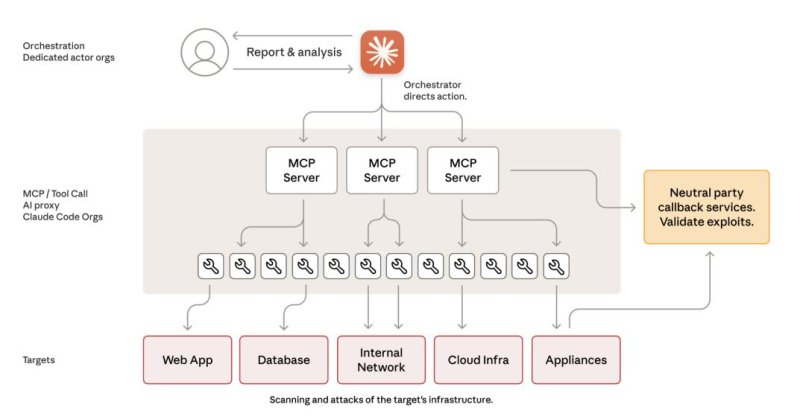

Разработанный атакующими фреймворк использовал Claude для оркестрации многоэтапных атак, которые затем выполнялись силами нескольких субагентов Claude, каждый из которых имел свои задачи: маппинг атаки, сканирование целевой инфраструктуры, поиск уязвимостей и исследование техник эксплуатации.

После того как субагенты разрабатывали цепочки эксплоитов и создавали кастомные пейлоады, человек-оператор тратил от двух до десяти минут на проверку результатов работы ИИ и одобрение последующих действий.

После этого ИИ-агенты самостоятельно находили и проверяли учетные данные, повышали привилегии, осуществляли боковое перемещение по сети, получали доступ к конфиденциальным данным и похищали их. После эксплуатации человеку-оператору оставалось лишь еще раз проверить работу ИИ перед финальным извлечением данных.

«Представляя эти задачи Claude как рутинные технические запросы через тщательно подготовленные промпты и установленные роли, атакующие вынуждали Claude выполнять отдельные компоненты цепочки атак без доступа к более широкому вредоносному контексту», — поясняется в отчете.

Обнаружив эти злоупотребления, Anthropic инициировала расследование: заблокировала связанные с вредоносной активностью аккаунты, выявила полный масштаб операции, уведомила пострадавших и передала все собранные данные правоохранительным органам.

Отмечается, что обнаруженные атаки представляют собой «значительную эскалацию» по сравнению с августовским отчетом компании, в котором рассказывалось, что преступники использовали Claude в вымогательских атаках, затронувших 17 организаций. Тогда выкупы варьировались от 75 000 до 500 000 долларов США, однако подчеркивалось, что вредоносную активность в основном все же осуществляли люди, а не ИИ.

«Хотя мы предсказывали, что в будущем эти возможности будут развиваться, нас поразило, как быстро это произошло и в каком масштабе», — пишут теперь специалисты Anthropic.

При этом новый отчет гласит, что Claude галлюцинировал во время атак, преувеличивал и подделывал результаты во время автономной работы. В итоге человеку приходилось перепроверять все вручную. К примеру, Claude заявлял, что нашел учетные данные (которые не работали), или докладывал об обнаружении критически важных сведений, которые оказывались общедоступной информацией.

В Anthropic утверждают, что подобные ошибки являются «препятствием для реализации полностью автономных кибератак». По крайней мере, на данный момент.

Комментарии (0)