Google: хакеры используют Gemini на всех этапах атак и пытаются заниматься дистилляцией - «Новости»

- 14:30, 14-фев-2026

- Новости / Изображения / Добавления стилей / Отступы и поля / Самоучитель CSS / Преимущества стилей

- Власта

- 0

Команда Google Threat Intelligence Group (GTIG) опубликовала отчет о масштабных злоупотреблениях большой языковой моделью Gemini. По данным корпорации, злоумышленники используют ИИ на всех этапах своих атак — от разведки до эксфильтрации данных. Более того, отдельные группы пытаются клонировать саму модель с помощью дистилляции, генерируя по 100 000 запросов.

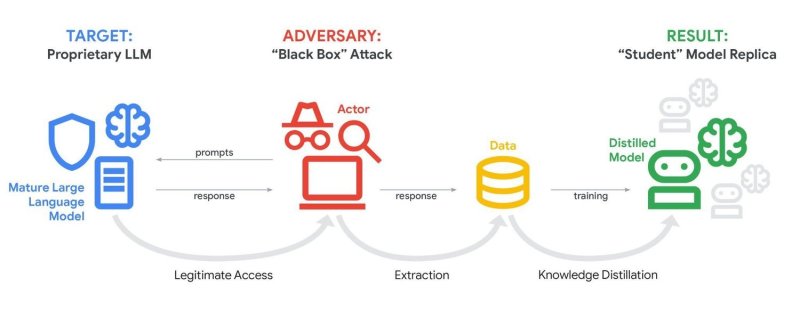

Аналитики Google пишут, что зафиксировали попытки извлечения знаний из Gemini через массовые запросы. В одном из случаев атакующие отправили модели более 100 000 промптов на разных языках, собирая ответы для обучения собственной, более дешевой копии, воспроизводящей процессы принятия решений для имитации функциональности.

Такая практика называется дистилляцией и представляет собой серьезную коммерческую и конкурентную проблему защиты интеллектуальной собственности. Принцип прост: вместо того чтобы тратить миллиарды долларов и годы на обучение собственной LLM, злоумышленники пытаются использовать уже существующую модель как шорткат. Атакующие бомбардируют Gemini тысячами тщательно подобранных промптов, собирают все ответы, а затем используют полученные данные для тренировки меньшей и более дешевой модели.

Также специалисты GTIG отмечают, что «правительственные» хак-группы из Китая (APT31, Temp.HEX), Ирана (APT42), Северной Кореи (UNC2970) и России активно используют Gemini для поддержки всех стадий своих атак — от разведки и создания фишинговых приманок до разработки управляющей инфраструктуры и кражи данных.

К примеру, китайские хакеры притворялись ИБ-экспертом, чтобы попросить Gemini автоматизировать анализ уязвимостей и предоставить целевые планы тестирования в рамках вымышленного сценария. В Google отмечают, что одна из группировок тестировала инструментарий Hexstrike MCP и просила модель анализировать удаленное выполнение кода, техники обхода WAF и результаты SQL-инжекций против конкретных американских целей.

В свою очередь, иранская APT42 использовала LLM для социальной инженерии, а также как платформу для ускорения создания кастомных вредоносных инструментов — от отладки до генерации кода и изучения техник эксплуатации.

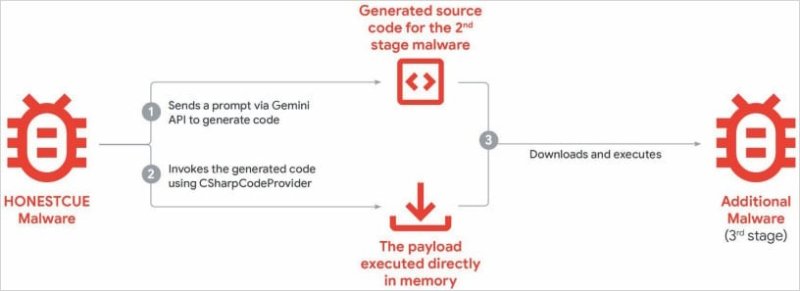

Также аналитики зафиксировали использование ИИ для внедрения новых возможностей в существующие семейства малвари, включая фишинг-кит CoinBait и загрузчик малвари HonestCue.

CoinBait представляет собой фишинговый набор, обернутый в SPA на React и маскирующийся под криптовалютный обменник для сбора учетных данных. Артефакты в коде указывают на то, что его разработка велась с использованием ИИ. К примеру, одним из признаков использования LLM являются сообщения с префиксом «Analytics:».

Исследователи GTIG полагают, что эта малварь была создана с использованием платформы Lovable AI, поскольку разработчик использовал клиент Lovable Supabase и приложение lovable.app.

Загрузчик HonestCue, в свою очередь, представляет собой PoC-фреймворк, который использует Gemini API для генерации кода на C# для второй стадии малвари, а затем компилирует и исполняет пейлоады в памяти.

Специалисты Google подчеркивают, что уже заблокировали аккаунты и инфраструктуру всех обнаруженных злоумышленников, а также внедрили новые защитные меры в классификаторы, чтобы усложнить подобные атаки в будущем.

Комментарии (0)